近期,MIT举办的“拓展计算机视野”系列讲座中,在“深度学习日”邀请了何凯明博士就生成模型这一主题发表演讲,我看了演讲视频[1]后,对主要内容进行了一个梳理,主要包括三个部分:生成模型概念、生成模型方法、生成模型的现实应用。

首先,何凯明博士以生成式AI技术在现代社会中的渗透性为脉络,通过聊天机器人、文本到图像生成、文本到视频生成、代码生成、蛋白质设计、气象预测等典型应用场景,生动展示了生成模型与现实生活的深度融合及其展现出的强大技术潜力。这些跨领域案例不仅勾勒出技术落地的清晰图景,更从多维度印证了生成模型的范式革新价值。随后,他便切入正题,从以下三个部分展开今天的演讲内容。

What?(什么是生成模型?)

何博士认为,这是一个非常难以回答的问题。随着生成模型越来越强大,它的范围会不断变化。从狭义上来讲,生成模型的训练是从原始数据分布到预测数据分布的映射,训练目标是无限逼近这两个分布,而生成则是从预测分布中采样产生新的数据。生成模型包括公式建模、表征、目标函数、优化器、推理等重要元素。

公式建模:即将现实问题建模为生成模型,这是算法设计最关键的部分之一;

表征:通常是一个深度神经网络,用以表示数据及其分布;

目标函数:主要用于衡量两个分布之间的差异;

优化器:选择合适的优化器来解决非常困难的优化问题;

推理:本质上是一个从底层分布中采样的采样器,如DDIM等

从广义上来说,生成模型在不断发展,其定义也逐渐延伸。现在已经不局限于文本、图像、音视频等媒体数据的复现,而是扩展到了将“生成”抽象为“对复杂系统的状态推演与决策模拟”,实现从“生成数据”到“生成知识/行为”的跨越,典型的有蛋白质结构预测、气象模拟等。

How?(生成模型的方法有哪些?)

接下来,何博士对当前的一些主要生成模型进行了介绍,包括Variational Autoencoder(VAE)、Generation Adversarial Network(GAN)、Autoregressive Models、Diffusion Models、Flow Matching。

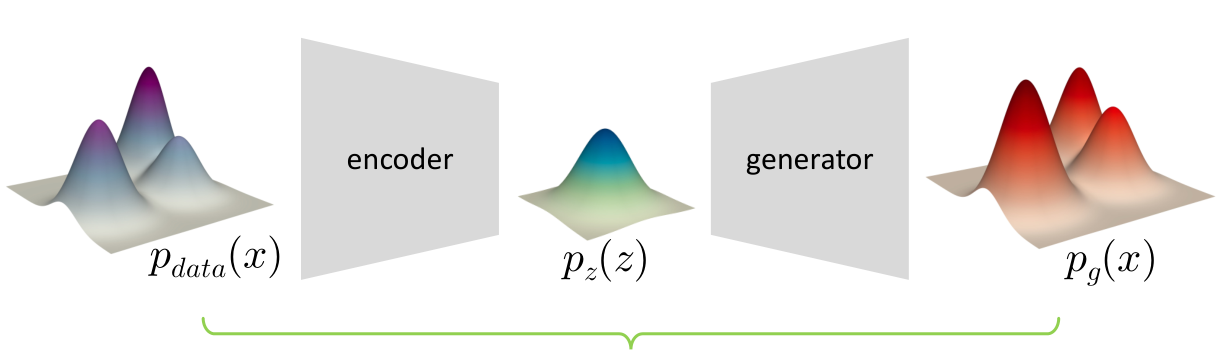

VAE:在该生成模型中,如果你拥有数据分布p_{data},那么你就可以训练一个神经网络(即encoder),映射数据分布到你所想要的数据分布p_{z}中,然后再通过学习生成器(即generator)将其转换回来。

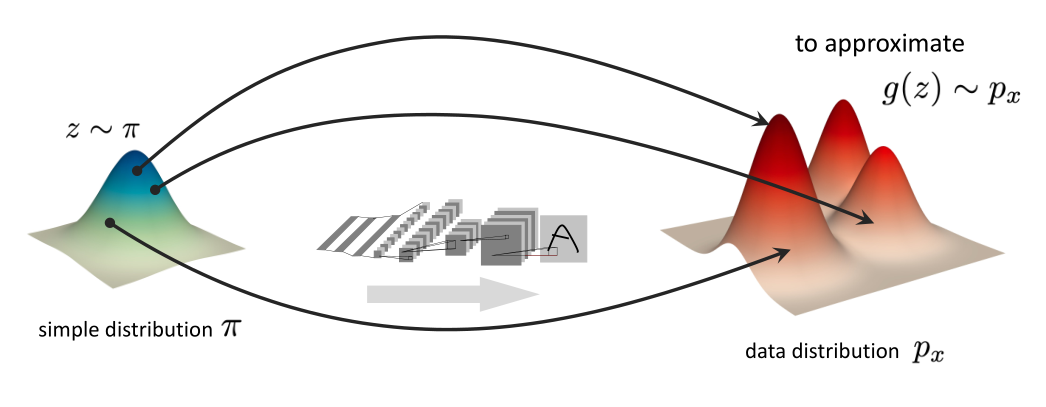

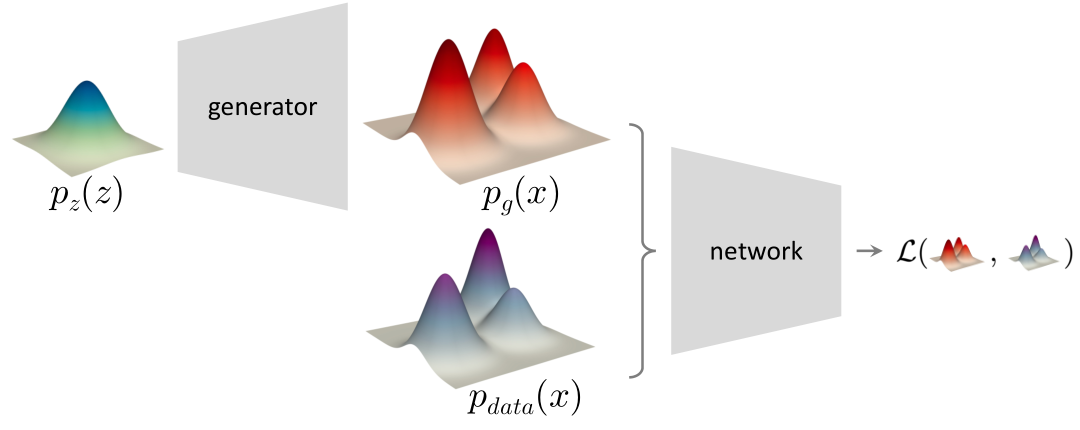

GAN:该生成模型并没有在采样分布前引入神经网络,而是在采样后引入了额外的神经网络,称为判别器。判别器的目标是给出样本来自预测分布还是实际分布的判断,如果判别器不能很好的分辨,则表示这两个分布非常相似。

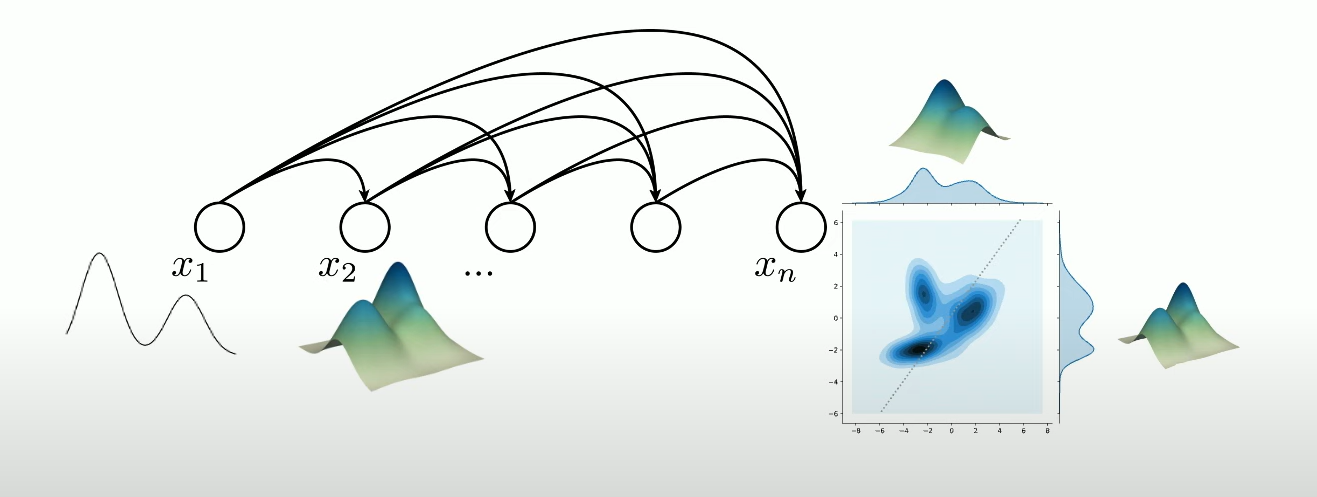

Autoregressive Models:在自然语言处理中,这通常被称为“下一个token预测”,但该模型不仅仅是预测下一个token。自回归模型的主要思想就是要对每一个条件概率单独建模而不是整个的联合概率建模。它将一个复杂问题拆分成若干个简单的小问题。

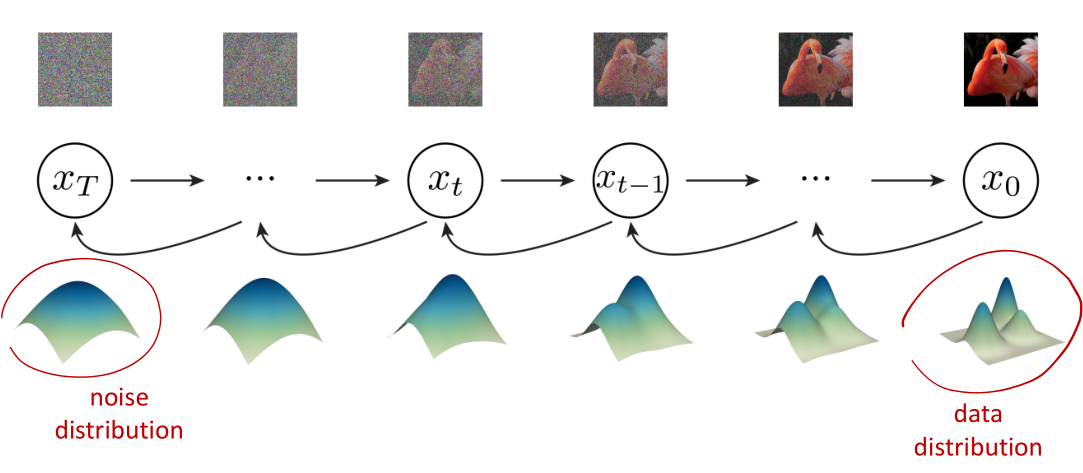

Diffusion Models:该生成模型受物理学中的热力学启发,主要过程是先通过对数据不断加噪得到纯噪声图像,然后学习的目标是逆转这个过程,即从噪声图像中恢复出原来的图像。

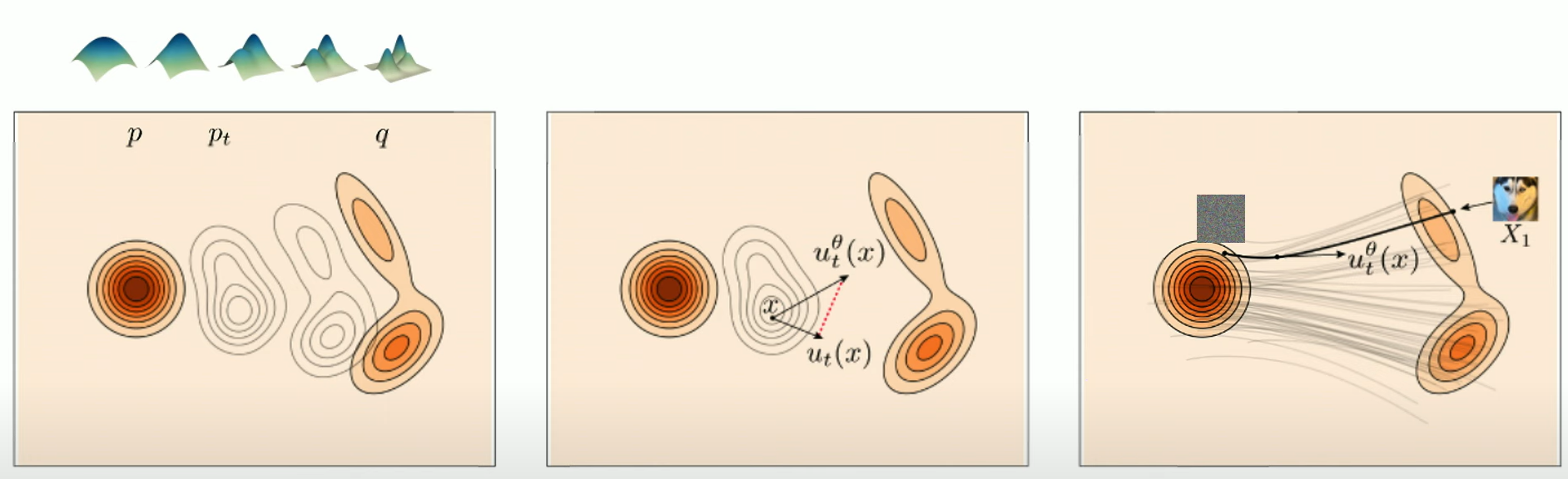

Flow Matching[2]:一种最新的生成模型方案,其思想是通过学习流场,将初始分布变换为目标分布。详细内容可进一步阅读相关文献。

生成模型会有一些深度神经网络作为构建块,就像深度神经网络有一些基本构成部分,如线性层、归一化层、ReLU等。所以,深度学习由各种层构建,生成模型由深度神经网络构建,从这个意义上说,生成模型是更高层次的抽象表示。

Contact! (生成模型与现实问题的联系!)

生成模型中的关键问题是两个分布之间的映射,如下图所示。

y是输入,代表条件,x是输出,代表数据。但在现实生活中,两者并不局限于某一种事物或情况,比如下面的各种示例。

自然语言对话:prompt ----> response of the chatbot

文生图/文生视频: text prompt ----> generated visual content

文生3D结构:text prompt ----> generated 3D structures

蛋白质结构预测:condition/constraint ----> generated protein structures

类条件图像生成:class label ----> generated image

无条件图像生成:an implicit condition ----> generated XXX-like images

图像分类:an image as the "condition" ----> probability of classes conditioned on the image

图像字幕:an image as the "condition" ----> plausible descriptions conditioned on the image

视觉增强型对话系统:image and text prompt ----> response of the chatbot

机器人策略学习:visual and other sensory observations ----> policies (probability of actions)

因此,从概念上讲,x、y可以是任何东西,这意味着我们可以构建特性形式的生成模型来解决现实世界的多种问题。

最后,何博士重申了“生成模型是更高层级的抽象表达”这一观点,十年前深度学习主要研究卷积层、激活函数、归一化等,而现在我们有了生成模型,研究的中心将围绕生成模型的构建块。当这些生成模型做出更多令我们惊叹的成果,如大语言模型(LLM)、推理(Reasoning)、代理(Agents),在这种情况下,生成模型将会称为下一个更高层次抽象表示的构建块。